Laurence Devillers z Francouzského národního centra vědeckého výzkumu (CNRS), specialistka na interakci lidí a robotů a autorka knihy Roboti a lidé (2017), hovoří o nutnosti udržovat hranici mezi stroji a lidmi a o tom, jak se robot učí vyjadřovat a rozpoznávat city.

Kdy robot nahradí člověka?

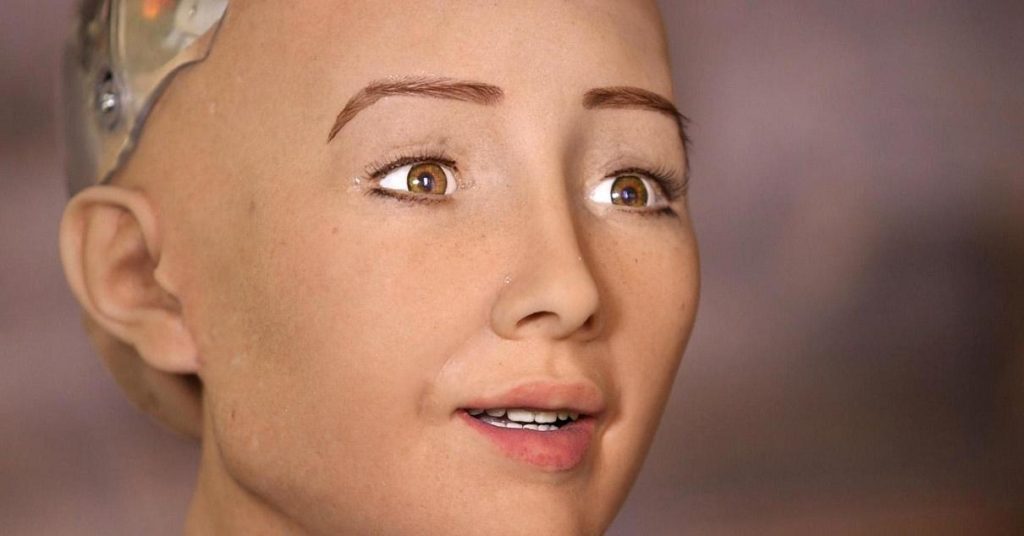

Jakmile budou roboti mluvit a mluvenému slovu rozumět. Robot Sophia od Hanson Robotics například mluví velmi gramaticky správně a souvisle, je to ale pořád jen odříkávání scénáře. Sophia není autonomní, a hlavně: nemá touhy ani úmysly. Je to loutka, do které konstruktéři nahráli scénář. Strojové učení jí umožňuje na základě dat scénáře zdokonalovat, ale nikoli řeči rozumět. Dosud není žádný robot, který by byl byť jen zárodkem člověka.

V roce 2018 Google přestavil robota Google Duplex, který umí sjednávat schůzky a mluví jako člověk. Nepřipadá vám to děsivé?

Veškerá moje práce se točí kolem myšlenky, že mezi lidmi a roboty musíme udržovat hranici. Google však napodobením lidského hlasu tuto hranici rozostřuje a otevírá dveře potenciálně neetickému využití robotů. Z technického hlediska se hlas napodobuje poměrně snadno. Můžete pomocí něj oklamat člověka, který neví, s kým mluví. Můžete fingovat výroky, který dotyčný člověk neřekl. Můžete dokonce nechat promluvit mrtvé. Je to zneužití důvěry.

Na vaší webové stránce se píše, že váš výzkum se týká „afektivního a sociálního rozměru verbálních interakcí s roboty“. Můžete nám to trochu vysvětlit?

Když se s někým bavíte, pak slovním i mimoslovním vyjadřováním předáváte nejen sémantické informace, ale také informace pocitové, tedy afektivní, a informace sociální. Mimoslovním vyjadřováním, například intonací hlasu, gesty, mimikou obličeje i tělesným postojem, dokážeme vyjádřit spoustu emocionálních informací. Pokoušíme se vytvářet stroje, které také mají tuto schopnost, které lidem rozumějí a chápou jejich city – empatické stroje, které zároveň samy dokážou emoce vyjadřovat.

Sophia, robot v lidské podobě od Hanson Robotics. Foto: Hanson Robotics

Sophia, robot v lidské podobě od Hanson Robotics. Foto: Hanson Robotics

To, že je důležité pochopit, co člověk cítí, aby bylo možné mu lépe vyhovět, to je celkem zřejmé. Proč by ale i stroj měl vyjadřovat nějaké pocity?

Třeba za účelem vzdělávání a ujištění lidí, se kterými robot jedná. Mám na mysli například kognitivní stimulaci lidí postižených Alzheimerovou chorobou. Robot může reagovat podobně jako kočka chováním, které napodobuje určité emoce. Pacient si pak může s robotem hrát jako s domácím zvířetem, získávat emocionální stimulaci a možnost vytvořit si společenský vztah. Se stárnutím populace zkrátka nebude dostatek personálu, který by se o takovéto pacienty staral. A stejně tak by roboti mohli pomáhat autistickým dětem, které špatně vyjadřují emoci a špatně chápou emoce druhých. Roboti jsou užiteční, musíme ale mít na paměti, že by měli lidi doplňovat, nikoli je nahrazovat.

Je u robota těžší rozumět pocitům lidí, nebo lidské pocity napodobovat?

Emoce je jakési vyjádření pocitu, rozhraní, přes něž komunikujeme s druhými lidmi. Emoce doprovázejí fyzické vjemy a fyzická jednání. Emoce se vyjadřují několika způsoby najednou, například zabarvením hlasu, výrazem tváře či gesty. Z technického hlediska je mnohem snazší emoce napodobovat, i když jsou izolované od fyzických vjemů, než emoce rozpoznávat.

Jaké algoritmy využíváte?

Postupujeme ve třech krocích: kódování, popis a model. Vezměme si jako příklad rozpoznávání emocí ze záznamu zvuku. V signálu si vybereme určitý počet „aspektů“, které nám poskytnou stovky a tisíce fyzických souřadnic. Zvukový záznam tedy nakódujeme do posloupnosti vektorů fyzických souřadnic. Kódování je nejsložitější fáze. Je třeba si vybrat vhodné parametry. Výsledkem musí být co nejkompaktnější informace, která však obsahuje dostatek informací k rozpoznání emocí. Po této první fázi posloupnosti vektorů označíme, například názvy emocí: hněv, radost, smutek… V další fázi algoritmus učení na základě signálu a označení vytvoří model. A tento model pak robot bude využívat. Model v zásadě předvídá, zda signál s vysokou pravděpodobností odpovídá té či oné emoci. Řečeno ještě jinak, program v zaznamenávaných datech, když například někdo mluví, rozpoznává podobnosti se signály, které již má ve výchozí databázi. Když tedy data v řeči člověka odpovídají signálu, který je označen jako „hněv“, pak robot usoudí, že daný člověk se hněvá.

Z toho, co říkáte, vyplývá, že na výchozích datech bude asi hodně záležet…

Naprosto. Většina z nich je vlastně umělá – jsou to například výrazy emocí, které pro nás vytvořili divadelní herci. A to je významné omezení. Výrazným směrem výzkumu je získat korpus dat o pocitech a emocích, který bude vycházet z reálných situací.

A jak poznáte, že se vám daří?

To je úplně snadné: z reakce člověka na chování robota. Konkrétně řečeno, když robot řekne „vypadá to, Marie, že jsi naštvaná“ a Marie řekne „je to tak, jsem naštvaná“, tak se nám to povedlo.

Autor: Petr Bílek